La IA está llegando a la negociación colectiva y las partes implicadas (RR.HH., abogados laboralistas y representantes sindicales) se enfrentan a la obligación de entenderse hablando el lenguaje de la transparencia algorítmica. ¿Pero qué es este concepto? Y sobre todo, ¿cómo se puede reflejar en un modelo o guía de trabajo? La normativa (RIA, RGPD, ET) proporciona el marco con alusiones claras a que la información proporcionada ha de ser significativa, clara, simple y comprensible para personas sin conocimientos técnicos. Y esto significa que aunque no hay obligación de revelar el código fuente, sí que la hay para explicar su lógica de funcionamiento.

La implementación de algoritmos y sistemas de inteligencia artificial (IA) en la gestión de recursos humanos promete transformar la toma de decisiones laborales y, si bien la velocidad es desigual por procesos, lo cierto es que parte de la ralentización se deriva de la inseguridad jurídica inherente a los modelos de IA de alto riesgo propios de aplicaciones como la biometría, la selección, elabsentismo o la productividad. Sumémosle la obligatoriedad de, en estos casos, realizar una evaluación de impacto sobre la protección de datos (EIPD) y tenemos el escenario perfecto para extremar la prudencia en su uso y la exactitud en la información que se tiene que dar de él.

La normativa europea y española establecen los grandes principios que han de regir la transparencia algorítmica como pilar de la inteligencia artificial responsable, articulando las obligaciones empresariales en dos niveles complementarios:

- Derecho individual de información (RGPD): Amparado en el Artículo 22 del Reglamento General de Protección de Datos de la UE, otorga a las personas el «derecho a una explicación» cuando son objeto de decisiones basadas únicamente en el tratamiento automatizado que produzcan efectos jurídicos o les afecten de forma significativa. Esto incluye el derecho a obtener intervención humana y a impugnar la decisión.

- Derecho colectivo de información (Estatuto de los Trabajadores): El Artículo 64.4.d del Estatuto de los Trabajadores de España obliga a las empresas a informar a la representación legal de la plantilla sobre los «parámetros, reglas e instrucciones» de cualquier algoritmo que afecte a las condiciones de trabajo o al empleo, incluyendo sistemas semi-automatizados que sirvan de apoyo a la decisión humana.

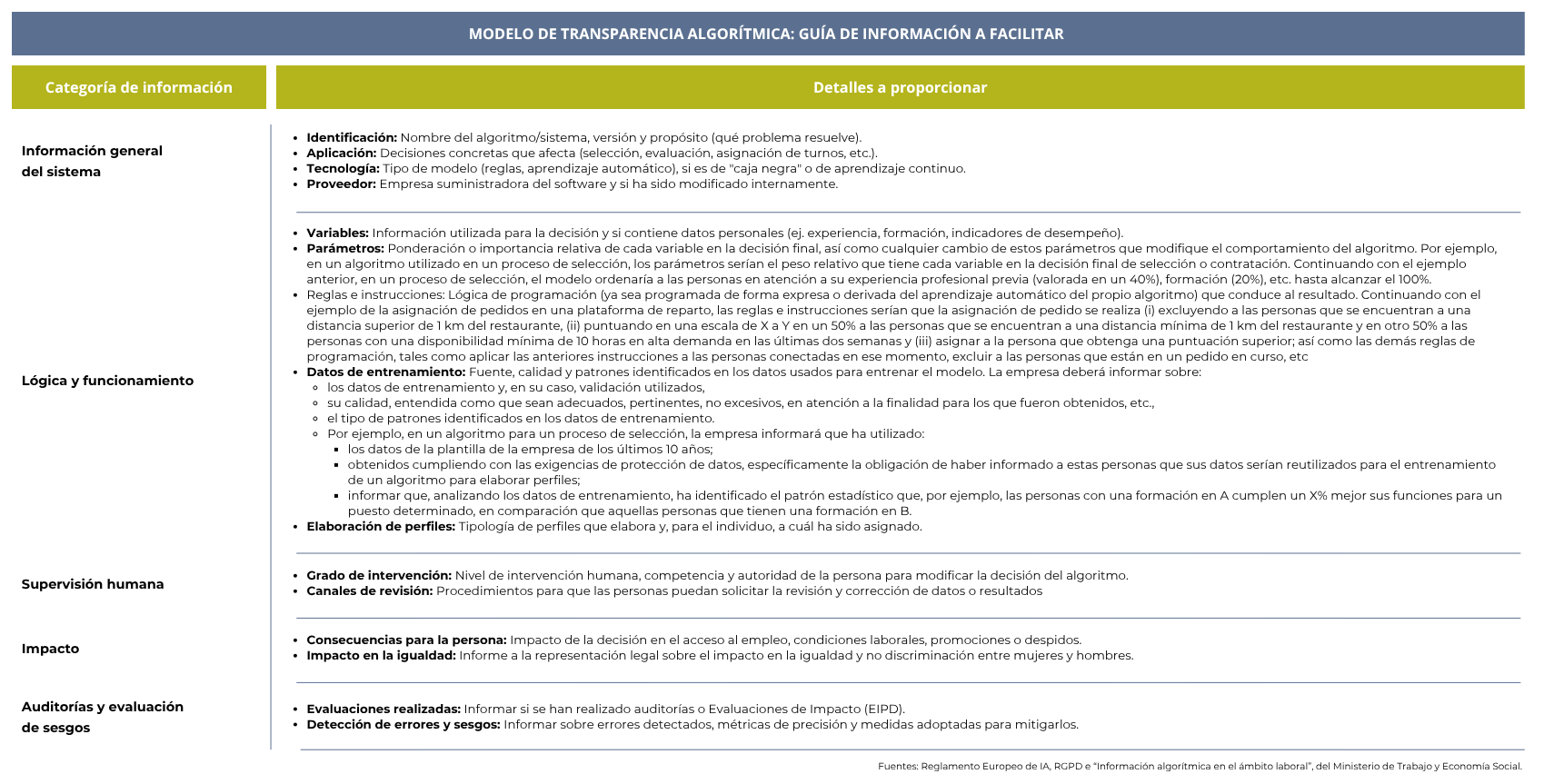

Así pues, las empresas deben proporcionar información significativa, clara y comprensible sobre la lógica de los algoritmos, las variables y parámetros utilizados, los datos de entrenamiento, el grado de supervisión humana y las consecuencias previstas para las personas trabajadoras. Aunque la negociación del algoritmo no es una obligación general, como veremos más adelante sí lo es en el contexto de medidas colectivas como despidos o modificaciones sustanciales de las condiciones de trabajo.

Primero, empezamos con los conceptos básicos:

- ¿Qué es la transparencia algorítmica? Es un requisito fundamental para asegurar que los sistemas de IA sean comprensibles, auditables y justos. Su objetivo principal es comunicar, documentar y auditar el funcionamiento de un sistema para garantizar su explicabilidad y trazabilidad.

- ¿Qué es la explicabilidad algorítmica? Es la capacidad de describir y justificar los procesos internos de un modelo de IA, permitiendo a los humanos entender por qué se ha tomado una decisión específica. Para lograrlo, se emplean técnicas y herramientas de IA Explicable (XAI), entre las que destacan:

-

- LIME (Local Interpretable Model-agnostic Explanations): Explica las predicciones individuales de cualquier modelo de clasificación de forma interpretable, mostrando qué variables influyen más en un resultado específico. Por ejemplo, por qué un modelo asignó una puntuación a un empleado o recomendó una formación. Lo hace mostrando qué variables influyeron más en ese resultado específico.

- SHAP (SHapley Additive exPlanations): Mide cuánto aporta cada variable a la decisión del modelo, de manera más matemática y global, y para ello asigna a cada característica un valor que representa su contribución a la predicción.

Ambas técnicas son esenciales para cumplir con el «derecho a una explicación» y fomentar la confianza de las partes interesadas, porque permiten identificar problemas de rendimiento, sesgos o resultados no deseados. Pero no son fácilmente entendibles para todo tipo de perfiles:

- Sí para personal técnico o de datos.

- No para trabajadores, sindicatos o RR.HH., porque los resultados suelen presentarse en gráficos o números difíciles de interpretar sin contexto.

Esta brecha de conocimiento compartido supone un desafío adicional para la explicabilidad, en la medida en que necesita ser trabajada desde el diseño del modelo, y de ahí el valor de los equipos multidisciplinares.

No obstante, el mayor reto de la explicabilidad y, por tanto, de la transparencia, está en los modelos de «caja negra”, aquellos cuyo funcionamiento interno es opaco o demasiado complejo para ser comprendido incluso aplicando las técnicas anteriormente citadas.

El deber de información

- ¿A quién y cuándo se debe informar? Todas las empresas que utilicen algoritmos para la gestión de personas tienen obligaciones de información, cuyo alcance varía en función de si cuentan o no con representación legal de la plantilla.

- A las personas trabajadoras (derecho individual): La información debe facilitarse previa al tratamiento de datos, es decir, antes de que se elabore el perfil o se tome la decisión automatizada.

- A la representación legal de la plantilla (derecho colectivo): Se debe informar previa a la utilización del algoritmo y ante cualquier cambio en sus variables, parámetros o funcionamiento.

- ¿Qué contenido hay que proporcionar? Como decíamos anteriormente, la información facilitada debe ser significativa, clara, simple y comprensible para personas sin conocimientos técnicos. El código fuente del algoritmo no necesita ser revelado, pero sí su lógica de funcionamiento. A continuación, se detalla el contenido común exigido por el RGPD y el ET.

A este respecto, el sindicato UGT ha elaborado el documento «Requerimiento legal para la petición de información sobre el uso laboral de IA y algoritmos» que incluye un listado de 11 preguntas que pueden formular los representantes de los trabajadores a sus empresas para obtener información relativa a lña transparencia y explicabilidad. El documento, según declara en su encabezado, ha sido redactado «de conformidad con el artículo 64.4.d del Estatuto de los Trabajadores, el artículo 4 Reglamento europeo de IA, la LOPD y el RGPD y con la finalidad cumplir con lo acordado en el V AENC, en el Acuerdo Marco Europeo de Digitalización y las estipulaciones inscritas en la Carta de Derechos Digitales».

Descarga el modelo de requerimiento legal

Otras cuestiones en materia de consultas y negociación

Más allá de la transparencia y explicabilidad, la normativa establece obligaciones proactivas de evaluación y diálogo en materia de:

- Evaluación de impacto sobre la protección de datos (EIPD), que es obligatoria antes de implementar un algoritmo si el tratamiento de datos supone un alto riesgo para los derechos y libertades como, por ejemplo en supuestos de:

- Tratamientos que impliquen la toma de decisiones automatizadas que impidan a una persona ejercer un derecho o acceder a un servicio.

- Uso de nuevas tecnologías o un uso innovador de tecnologías consolidadas.

- Consulta a la representación legal: Según el Artículo 64.5 del ET, la empresa debe informar y consultar a la representación legal de la plantilla con carácter previo a la implantación de sistemas de organización y control del trabajo, categoría que incluye los algoritmos de gestión de personas.

- Negociación del algoritmo: No existe una obligación general de negociar el algoritmo salvo que se utilice en el marco de medidas colectivas que legalmente requieren un período de consultas, tales como:

- Despidos colectivos (Art. 51 ET).

- Modificaciones sustanciales de condiciones de trabajo de carácter colectivo (Art. 41.4 ET).

- Movilidad geográfica colectiva (Art. 40.2 ET).

- Negociación colectiva: Los convenios colectivos pueden introducir la obligación de negociar las características del algoritmo.

Si la EIPD advierte de un riesgo de vulneración de derechos fundamentales (p. ej., efectos discriminatorios), el diseño del algoritmo debe ser modificado.

Fuentes:

- «Información algorítmica en el ámbito laboral». Ministerio de Trabajo y Economía Social, 2022.

- Reglamento Eurpeo de IA.

- Estatuto de los Trabajadores.

- Reglamento General de Protección de Datos.

- «Requerimiento legal para la petición de información sobre el uso lboral de la IA y algoritmos». UGT.

- «Recomendaciones para la negociación colectiva de la IA». UGT.

*Nota: Hemos utilizado herramientas de IA para compilar la información y estructurar los elementos gráficos, y el texto final es el resultado de la validación de fuentes y de la consolidación de los contenidos por parte de la Redacción de ORH.

Maite Sáenz es CEO de ORH, una plataforma de conocimiento e innovación en gestión estratégica de personas en las organizaciones que fundé en 2006. Se licenció en Periodismo y ha desarrollado toda su carrera profesional en el ámbito de la información especializada en gestión estratégica de personas en las organizaciones. Durante 16 años se desempeñó como redactora-jefe de la revista Capital Humano y en 2006 fundó ORH Grupo Editorial de Conocimiento y Gestión, un proyecto quue define como no sólo profesional sino también vital, en el que refleja su forma de entender las relaciones empresa-empleado.

Maite Sáenz es CEO de ORH, una plataforma de conocimiento e innovación en gestión estratégica de personas en las organizaciones que fundé en 2006. Se licenció en Periodismo y ha desarrollado toda su carrera profesional en el ámbito de la información especializada en gestión estratégica de personas en las organizaciones. Durante 16 años se desempeñó como redactora-jefe de la revista Capital Humano y en 2006 fundó ORH Grupo Editorial de Conocimiento y Gestión, un proyecto quue define como no sólo profesional sino también vital, en el que refleja su forma de entender las relaciones empresa-empleado.